IA en servicios financieros: de innovación a Riesgo legal a Compliance

Durante un tiempo, la conversación sobre inteligencia artificial en el sector financiero giró alrededor de eficiencia, automatización y experiencia del cliente. Ese ciclo ya cambió.

Hoy, la IA generativa dejó de ser únicamente una herramienta de innovación. Para bancos, fintechs, aseguradoras, SOFOMES, wallets y proveedores tecnológicos, se convirtió en un tema de gobierno corporativo, cumplimiento regulatorio, protección al consumidor, trazabilidad, sesgos, manejo de terceros y responsabilidad legal. Además, el AI Act europeo ya comenzó a aplicarse por fases, y su efecto práctico va mucho más allá de Europa.

La pregunta ya no es si conviene usar IA. La pregunta correcta es otra: cómo usarla sin abrir un frente de contingencia legal, operativa o reputacional.

El nuevo problema: la IA no elimina riesgo, lo redistribuye

En servicios financieros, un error no es un detalle técnico. Puede convertirse en un rechazo indebido de crédito, una mala evaluación de riesgo, una alerta falsa de fraude, una recomendación deficiente al cliente o una respuesta incorrecta en canales de atención.

Cuando eso ocurre, el problema deja de ser tecnológico y se vuelve jurídico y regulatorio.

Distintos organismos internacionales ya han advertido que el uso de IA en finanzas trae riesgos concretos en materia de explicabilidad, calidad de datos, sesgos, ciberseguridad, gobernanza, privacidad y dependencia de terceros.

En otras palabras: usar IA sin estructura de control ya no es sofisticación; es exposición.

¿Cuáles son los principales retos éticos y de cumplimiento en finanzas?

El primer reto es la falta de explicabilidad. En el sector financiero no basta con que un

sistema entregue un resultado. La institución debe poder justificar por qué ese resultado fue emitido, sobre todo cuando impacta derechos, acceso a productos, condiciones comerciales o experiencia del usuario. El modelo “la herramienta lo decidió” no resiste revisión seria.

El segundo reto es el sesgo. Si un modelo fue entrenado con datos incompletos, históricos o mal depurados, puede reproducir o amplificar patrones de discriminación. En crédito, seguros, prevención de fraude o perfilamiento comercial, eso puede traducirse en exclusión financiera, trato desigual y potencial litigio.

El tercer reto es la trazabilidad. Muchas organizaciones implementan soluciones de IA antes de definir quién aprobó el caso de uso, qué versión del modelo está operando, qué datos se utilizaron, qué controles de validación existen y quién debe intervenir si el sistema falla. Sin trazabilidad, no hay defensa sólida frente a auditoría, reclamo o investigación.

El cuarto reto es el cumplimiento transversal. En México, aunque todavía no existe una ley general consolidada de IA aplicable horizontalmente, sí existen obligaciones vigentes en protección de datos, seguridad de la información, continuidad operativa, contratación con terceros y protección al usuario financiero. La regulación ya alcanza a la IA aunque no siempre la nombre de forma expresa.

¿Quién responde legalmente por un error de la IA?

Este es el punto que más interesa al negocio y el que más suele malinterpretarse.

La IA no asume responsabilidad legal. El proveedor del modelo tampoco absorbe

automáticamente todo el riesgo. En la práctica, la entidad que utiliza la herramienta

para prestar un servicio, interactuar con clientes o soportar una decisión de negocio

sigue siendo el primer frente de exposición frente al usuario, la autoridad y el supervisor.

Eso no significa que el proveedor tecnológico quede fuera. Significa que la responsabilidad debe analizarse por capas: diseño del sistema, implementación, configuración, supervisión, calidad de datos, monitoreo,contratación y uso concreto dentro del flujo operativo. El problema es que, frente al cliente, normalmente quien da la cara no es el desarrollador del modelo. Es la institución

Por eso, la pregunta correcta no es “¿de quién fue la falla?”. La pregunta correcta es: ¿qué controles existían para prevenirla, detectarla, corregirla y documentarla?

¿Qué impacto tiene el AI Act europeo en las finanzas en México?

Más del que muchas empresas creen.

El AI Act de la Unión Europea ya entró en vigor y se está aplicando por etapas. Algunas

obligaciones ya son exigibles, y el marco completo seguirá desplegándose entre 2025 y 2027.

Además, su alcance no se limita a empresas físicamente establecidas en Europa. Puede impactar a actores fuera de la UE cuando colocan sistemas en ese mercado, los ponen en servicio allí o sus resultados se utilizan en territorio europeo.

Para el sector financiero, esto es especialmente relevante porque el reglamento considera de alto riesgo ciertos usos vinculados con evaluación de solvencia, crédito y tarificación en seguros. Eso eleva el estándar de gestión de riesgos, gobernanza, documentación, supervisión humana y calidad de datos.

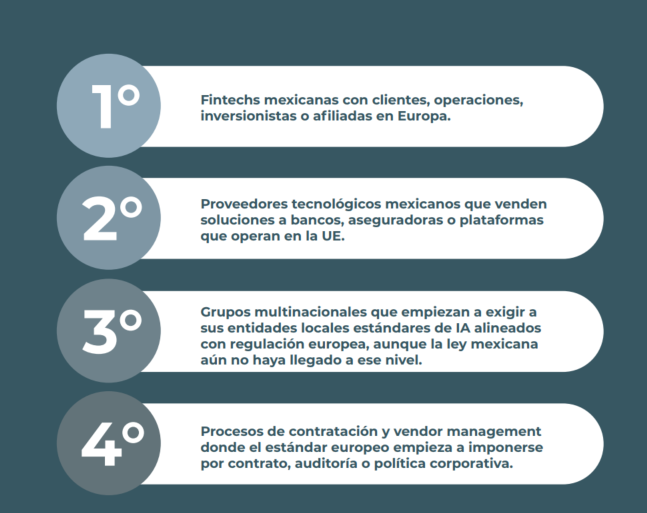

Para México, el impacto se materializa en al menos cuatro escenarios muy claros.

La conclusión es simple: aunque tu entidad opere en México, el AI Act puede terminar afectando tu modelo de cumplimiento, tus contratos y tus controles internos.

¿Qué medidas ayudan a mitigar los sesgos y reducir la exposición legal?

Aquí no sirve la narrativa. Sirve el gobierno.

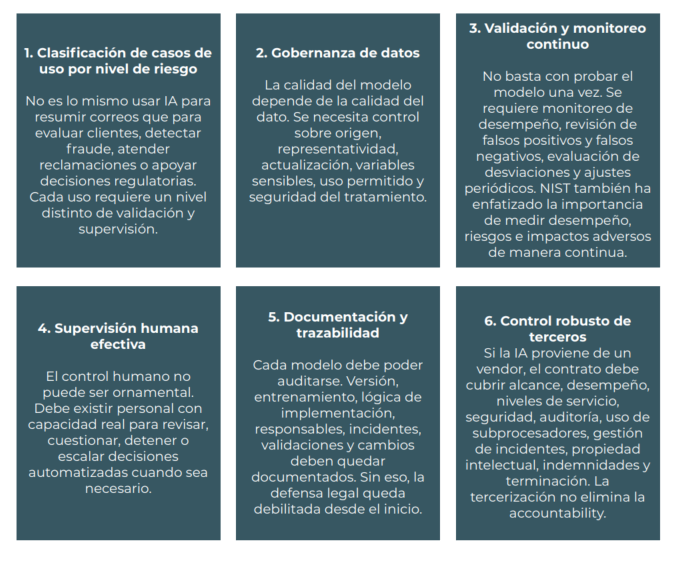

Una institución financiera que utiliza IA de forma seria debería tener, como mínimo, estas líneas de control:

Lo que viene para el sector financiero

En México, el debate legislativo sobre IA ya comenzó a moverse a nivel institucional y

parlamentario. Pero incluso antes de que exista una ley general plenamente desarrollada, el estándar regulatorio ya cambió en la práctica: hoy se espera que las entidades financieras usen tecnología con controles, documentación y responsabilidad.

Eso significa que la ventaja competitiva ya no está en ser “early adopter” de IA a cualquier costo.

La ventaja real está en ser una organización que la adopta con estructura, criterio legal y disciplina operativa.